Regressão Linear Simples e o Método dos Mínimos Quadrados

9833 - Bases da Matemática e Estatística para Ciências do Mar

Fabio Cop Ferreira e William Remo Pedroso Conti

Conteúdo da Aula

- Introdução à Regressão Linear Simples

- Definição dos Resíduos

- Método dos Mínimos Quadrados

- Representação Vetorial dos Resíduos

- Geometria da Solução de Mínimos Quadrados

- Solução Matricial do Método dos Mínimos Quadrados

Introdução à Regressão Linear Simples

A regressão linear simples é um método para modelar a relação entre uma variável dependente $y$ e uma variável independente $x$. A equação da reta ajustada é dada por:

$$\hat{y} = \beta_0 + \beta_1 x$$| Observação | $x_i$ | $y_i$ |

|---|---|---|

| $1$ | $x_1$ | $y_1$ |

| $2$ | $x_2$ | $y_2$ |

| $3$ | $x_3$ | $y_3$ |

| $\vdots$ | $\vdots$ | $\vdots$ |

| $n$ | $x_n$ | $y_n$ |

Definição dos Resíduos

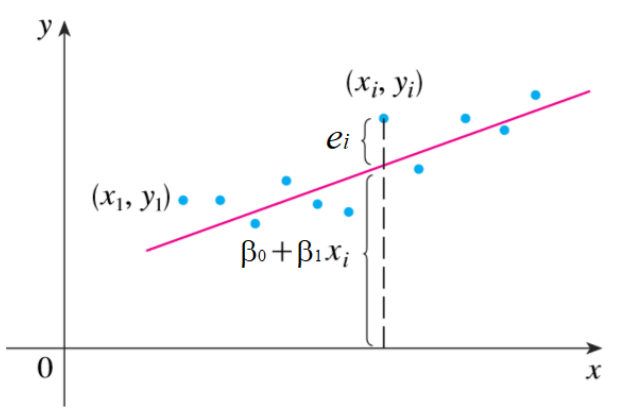

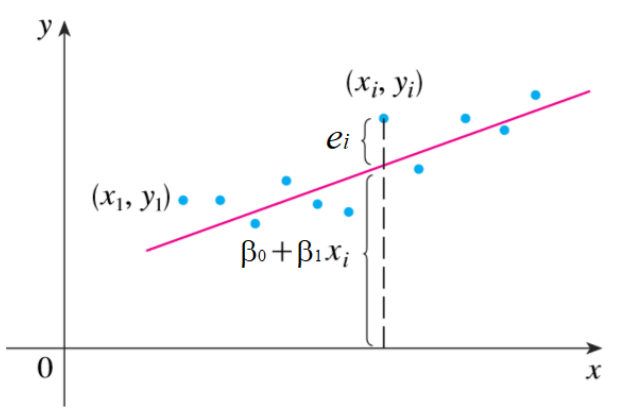

Na figura abaixo, os resíduos $e_i$ representam as diferenças entre os valores observados $y_i$ e os valores ajustados $\hat{y}_i$ pela reta de regressão:

$$e_i = y_i - (\beta_0 + \beta_1 x_i)$$Portando na regressão linear, assume-se que o valor observado em $y_i$ é dado por:

$$y_i = \beta_0 + \beta_1 x_i + e_i$$Acesse o link Regressão linear Geogebra

| Observação | $x_i$ | $y_i$ |

|---|---|---|

| $1$ | $x_1$ | $y_1$ |

| $2$ | $x_2$ | $y_2$ |

| $3$ | $x_3$ | $y_3$ |

| $\vdots$ | $\vdots$ | $\vdots$ |

| $n$ | $x_n$ | $y_n$ |

Método dos Mínimos Quadrados

O Método dos Mínimos Quadrados busca minimizar a soma dos quadrados dos resíduos:

$$SQ_{res} = \sum_{i=1}^{n} e_i^2 = e_1^2 + e_2^2 + \cdots + e_n^2$$Que pode ser representada como:

$$ \begin{cases} e_1 = y_1 - (\beta_0 + \beta_1 x_1) \\ e_2 = y_2 - (\beta_0 + \beta_1 x_2) \\ \vdots \\ e_n = y_n - (\beta_0 + \beta_1 x_n) \\ \end{cases} $$Representação Vetorial dos Resíduos

Podemos portanto representar os resíduos como vetor em que o vetor $\vec{e}$ é igual ao vetor $y$ menos uma combinação linear dos vetores $\vec{f}_0$ e $\vec{f}_0$ com constantes $\beta_0$ e $\beta_1$.

$$\vec{e} = \vec{y} - (\beta_0 \vec{f}_0 + \beta_1 \vec{f}_1)$$

Representação Vetorial dos Resíduos — Notação

Onde:

Geometria da Solução de Mínimos Quadrados

A Soma dos quadrados dos resíduos ($SQ_{res}$) pode ser obtida pela norma ao quadrado do vetor $\vec{e}$:

$$SQ_{res} = \Vert\vec{e}\Vert^{2}=\vec{e}\cdot\vec{e}=e_{1}^{2}+e_{2}^{2}+\cdots+e_{n}^{2}$$O Método dos Mínimos Quadrados determina $\beta_0$ e $\beta_1$ de modo a minimizar o comprimento (a norma) do vetor $\vec{e}$ que pode ser obtida impondo que o vetor $\vec{e}$ seja ortogonal aos vetores $\vec{f}_0$ e $\vec{f}_1$, ou seja:

$$\vec{f}_0 \cdot \vec{e} = 0$$ $$\vec{f}_1 \cdot \vec{e} = 0$$Geometria da Solução de Mínimos Quadrados

$$ \left\{\begin{array}{c} \vec{f}_0 \cdot \vec{e} = 0 \Leftrightarrow \vec{f}_0\cdot(\vec{y}-\beta_0\vec{f}_0-\beta_1\vec{f}_1)=0\\ \vec{f}_1 \cdot \vec{e} = 0 \Leftrightarrow \vec{f}_1\cdot(\vec{y}-\beta_0\vec{f}_0-\beta_1\vec{f}_1)=0 \end{array} \right. $$que é equivalente a:

$$ \left\{\begin{array}{c} \beta_0\vec{f}_0\cdot\vec{f}_0+\beta_1\vec{f}_0\cdot\vec{f}_1=\vec{f}_0\cdot\vec{y}\\ \beta_0\vec{f}_1\cdot\vec{f}_0+\beta_1\vec{f}_1\cdot\vec{f}_1=\vec{f}_1\cdot\vec{y} \end{array} \right., $$que ainda pode ser escrito na forma matricial:

$$ \left[ \begin{array}{cc} \vec{f}_0\cdot\vec{f}_0 & \vec{f}_0\cdot\vec{f}_1\\ \vec{f}_1\cdot\vec{f}_0 & \vec{f}_1\cdot\vec{f}_1 \end{array} \right] \left[ \begin{array}{c} \beta_0\\ \beta_1 \end{array} \right] = \left[ \begin{array}{c} \vec{f}_0\cdot\vec{y}\\ \vec{f}_1\cdot\vec{y} \end{array} \right] $$Solução Matricial do Método dos Mínimos Quadrados

A combinação linear:

$$ \left[ \begin{array}{cc} \vec{f}_0\cdot\vec{f}_0 & \vec{f}_0\cdot\vec{f}_1\\ \vec{f}_1\cdot\vec{f}_0 & \vec{f}_1\cdot\vec{f}_1 \end{array} \right] \left[ \begin{array}{c} \beta_0\\ \beta_1 \end{array} \right] = \left[ \begin{array}{c} \vec{f}_0\cdot\vec{y}\\ \vec{f}_1\cdot\vec{y} \end{array} \right] $$por ser expressa pelas matrizes:

$$X = \left[ \begin{array}{ccc} \vec{f}_0 & \vdots & \vec{f}_1 \end{array} \right] = \left[ \begin{array}{cc} 1 & x_1 \\ 1 & x_2 \\ \vdots & \vdots \\ 1 & x_n \\ \end{array} \right]; Y = \left[ \begin{array}{c} y_1 \\ y_2 \\ \vdots \\ y_n \\ \end{array} \right]; B = \left[ \begin{array}{c} \beta_0 \\ \beta_1 \\ \end{array} \right] $$Solução Matricial — Estimativa de Mínimos Quadrados

E finalmente:

$$B = (X^{T} X)^{-1}(X^{T}Y)$$